Datenanalysen können das eigene Geschäft beflügeln. Doch dafür braucht es die richtigen Lösungen und Werkzeuge. Die Hersteller bringen laufend neue Tools für Advanced Analytics und Big Data auf den Markt. Lesen Sie, welche Tools Ihnen weiterhelfen können. [...]

+++ EDB STARTET OPERATIONALE DATENBANK-MANAGEMENT-PLATTFORM +++

Mit der „EDB Postgres Platform“ hat Enterprise DB eine neue Datenplattform vorgestellt, auf deren Basis Anwenderunternehmen das Handling ihrer Daten effizienter abwickeln könnten. Der Hersteller beschreibt seine Lösung als integrierte operationale Daten-Management-Plattform auf Open-Source-Basis, die verschiedene Komponenten für die Verwaltung von strukturierten und unstrukturierten Daten in einem föderierten Modell vereinige. Die Plattform ermögliche die Integration verschiedener Datenbanken, unterstütze aber auch die Kombination unstrukturierter Daten von NoSQL-Lösungen und transaktionaler Unternehmensdaten in strukturierten relationalen Systemen.

Kunden können zwischen zwei EDB-Postgres-Database-Server-Versionen wählen: dem „EDB Postgres Standard Server“, einer Open-Source-PostgreSQL-Datenbank, oder dem „EDB Postgres Advanced Server“, einer erweiterten Version von PostgreSQL mit ausgebauter Performance, Skalierbarkeit sowie Sicherheitsfunktionen und Kapazitäten für den professionellen Unternehmenseinsatz. Die Plattform beinhaltet dem Hersteller zufolge darüber hinaus eine „Management Suite“ mit Funktionen für Disaster Recovery sowie für das Monitoring und Management des Gesamtsystems. Der Anbieter verspricht an dieser Stelle schnellere Multi-Master-Replikation sowie die Bereitstellung privater Clouds auf Basis von OpenStack.

Mit Hilfe der ebenfalls integrierten „Migration Suite“ sollen Anwender mit ihren Workloads leichter umsteigen können. EDB verweist an dieser Stelle ausdrücklich auf die Kompatibilität der Lösung mit Oracle-Systemen. Die „Integration Suite“ soll Anwender dabei unterstützen, die Plattform mit anderen Systemen wie beispielsweise Hadoop und MongoDB zu verknüpfen. Dafür ständen eine Reihe von Datenadaptern zur Verfügung, die auf der Foreign-Data-Wrapper- (FDW-)Technik von Postgres basierten.

Die EDB Postgres-Plattform umfasst im Einzelnen:

- Die Auswahl zwischen zwei EDB Postgres Database-Serverversionen: EDB Postgres Standard Server, eine Open Source PostgreSQL-Datenbank oder EDB Postgres Advanced Server, eine erweiterte Version von PostgreSQL mit ausgebauter Performance, Skalierbarkeit sowie Sicherheitsfunktionen und Kapazitäten für den professionellen Unternehmenseinsatz;

- Management-Suite;

- Migration-Suite;

- Integration-Suite;

- Support und Services.

EDB Postgres-Plattform – Features und Funktionen:

- EDB Replication Server;

- Cloud Management, Bereitstellung privater Clouds auf OpenStack;

- Datenadapter für die Integration von EDB Postgres mit anderen Datenmanagement-Lösungen, um hybride Datenplattformen zu erstellen: Hadoop, MongoDB und MySQL Datenadapter.

+++ ATOS BAUT INTEGRIERTE LÖSUNG FÜR DATA LAKES UND ANALYTICS +++

Über seine Technologiemarke Bull hat Atos die Big-Data-Lösung „Data Lake and Analytics Factory by bullion“ vorgestellt. Integriert mit dem bullion Server als Plattform soll die Lösung Anwendern dabei helfen, Daten zu erfassen, zu speichern und zu analysieren. Dadurch erhöhe sie die Flexibilität, Sicherheit und Effizienz bei der Echtzeit-Datenanalyse. Unternehmen könnten so schnell und kosteneffizient Mehrwert aus bestehenden Daten ziehen, verspricht der Hersteller. Data Lake and Analytics Factory by bullion basiere auf einer offenen Architektur, die sich einfach implementieren und integrieren lassen soll, und zudem moderne Analysewerkzeuge enthalte, hieß es. Ein vorkonfigurierter Data Lake soll sich damit innerhalb weniger Wochen implementieren, dazugehörige Big-Data-Anwendungen in Tagen anstatt in Wochen oder Monaten entwickeln lassen.

Die Software-Suite bietet laut Hersteller folgende Elemente:

- Kombinierte Produkte, um zentrale Datenverarbeitungs- und Analysefunktionen, wie intelligente Protokollanalyse, Suche und Geolokalisierung, bereitzustellen.

- Moderner Data Lake auf Hadoop-Basis, der sich schnell bereitstellen und einfach verwalten lassen soll. Data Scientists könnten dadurch den Verwaltungsaufwand verringern und durch die zusätzlichen Ressourcen Mehrwert schaffen.

- Self-Service-Katalog, der mittels validierter und zielgerichteter Vorgaben den Zugang zu Komponenten vereinfachen, die Effizienz der Bereitstellung verbessern und so IT-Prozesse optimieren soll.

- Flexible und skalierbare Software-Ebene, die das Datenwachstum in unterschiedlichen Umgebungen (On-Premise oder in der Cloud) unterstützen soll.

Arnaud Bertrand, Senior Vice President des Bereichs Big Data & HPC bei Atos, meint: „Wir haben das Ziel, Kunden beim Übergang zu Big Data zu unterstützen. Mit Data Lake and Analytics Factory by bullion können Unternehmen Big-Data-Lösungen mithilfe einer effizienten, sicheren und leistungsfähigen Lösung schneller implementieren. Eine End-to-End-Integration – von der Hardware- bis zur Softwareebene – steigert dabei die Performance.“

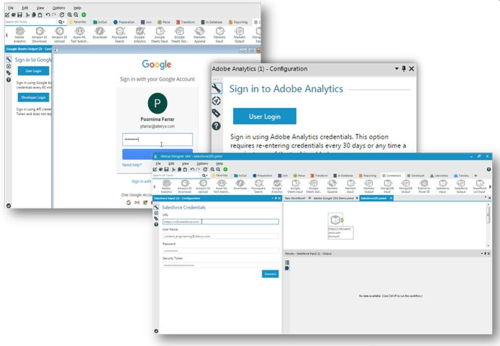

+++ ALTERYX ANALYTICS 10.5 BINDET MEHR DATENQUELLEN EIN +++

Alteryx, Inc. hat die Verfügbarkeit seiner neuen Version Alteryx Analytics 10.5 bekannt gegeben. , die es Analysten, auch in den Fachabteilungen, sollen damit in die Lage versetzt werden, Daten aus verschiedenen Quellen aufzubereiten und zu verbinden. Darüber hinaus biete das neue Release laut Hersteller mehr Möglichkeiten, Self-Service-Funktionen organisationsweit zu skalieren. Alteryx verspricht Anwendern mit Analytics 10.5 mehr Produktivität durch:

- Zugriff auf Cloud-Daten und andere Big-Data-Quellen – Datenanalysten sollen neue Erkenntnisse durch die Einpflege von Daten aus Amazon Aurora, Google Sheets, Adobe Analytics und Salesforce.com erhalten. Zudem hätten sie auch die Möglichkeit, große Datenmengen ohne HQL- oder SQL-Kodierung direkt in Apache Hive und Microsoft Azure SQL Data Warehouse aufzubereiten und zu verknüpfen.

- Einfache Bereitstellung und Skalierbarkeit der Analytik – Datenanalysten seien mit dem neuen Release in der Lage, ihren Workflow als anpassbare Anwendung sicher auf dem Alteryx Server bereitzustellen und die Self-Service Data Analytics damit einem größeren Teil der Organisation zugänglich zu machen, ohne die Data Governance zu gefährden.

- Zunahme der Anzahl an Geschäftsanalysten – Analysten könnten in allen geografischen Regionen schneller Erkenntnisse gewinnen, so der Hersteller. Damit gebe es auch mehr Möglichkeiten, Workflow-Mustertools und vorgefertigte Analysen zur Generierung komplexer Analysen in Englisch, Französisch und Deutsch zu nutzen und anderen Analysten dabei zu helfen, ihre analytischen Fertigkeiten auszubauen. Mit zusätzlichen neuen internationalen raumbezogenen Drittdaten und Geo-Referenzierungsfähigkeiten für Kanada, das Vereinigte Königreich/Irland, Kontinentaleuropa, Australien/Neuseeland und Brasilien ließen sich zudem nun auch komplizierte Raumanalysen im globalen Maßstab durchführen.

+++ SINEQUA 10 INTEGRIERT MACHINE-LEARNING-ALGORITHMEN +++

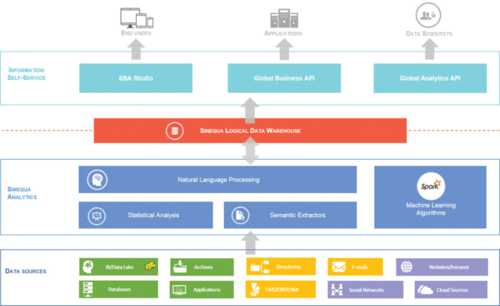

Sinequa hat die neue Version 10 seiner gleichnamigen Search- und Analyse-Plattform veröffentlicht. Features für maschinelles Lernen sollen tiefere Analysen von Inhalten und Nutzerverhalten liefern. Die selbstlernende Plattform für kognitive Suche und Analyse mache Informationen für Nutzer im Self-Service verfügbar und sei für Administratoren einfach steuerbar, verspricht der Hersteller.

Sinequa hat das Apache Spark Framework für Cluster Computing in seine Architektur integriert. So könnten die Vorteile der rechnerintensiven Machine-Learning-Algorithmen besser ausgeschöpft werden. Kontinuierlich analysierten diese die Inhalte des Sinequa Logical Data Warehouse und reicherten dessen Inhalt an. Das Logical Warehouse stellt das Datenreservoir aller von Sinequa analysierten und indizierten Unternehmensinhalte dar. Mit Hilfe der neu implementierten Algorithmen liefere die kognitive Plattform in der Version 10 laut Anbieter bessere Einblicke und relevantere Informationen, die sich stärker an den Anforderungen der Nutzer orientierten.

Neben den Machine-Learning-Algorithmen enthält Release 10 weitere neue Features: Eingebaut ist beispielsweise Sinequa „Native Resident“ von Cloud-Plattformen wie Amazon Web Services (AWS) und Microsoft Azure und optimiert die Nutzung der Ressourcen dieser Plattformen. Für Kunden im Bereich Life Science und Health Care wurden branchenspezifische Werkzeuge für ontologische und schnelle Textindizierung von Partnern wie Scibite und Lingua integriert. Sinequa verwendet außerdem Google Vision und Microsoft Azure Media Services, um Videos und Bildern effektiver zu verwalten. Google wird außerdem für die automatisierte Übersetzung von über 100 Sprachen verwendet. Mit plug&play-Anbindungen zu mehr als 150 verschiedensten Repositories für strukturierte und unstrukturierte Daten wächst zudem die Konnektivität von Sinequa, um zusätzliche Erkenntnisse aus Enterprise Applications, Hadoop und Cloud-Umgebungen zu generieren.

+++ EMC PRÄSENTIERT MIT UNITY NEUES ALL-FLASH-ARRAY +++

EMC hat auf der EMC World in Las Vegas „Unity“ vorgestellt. Dabei handelt es sich eine neue Familie von Speicher-Produkten, die Kunden die Modernisierung ihrer Rechenzentren erleichtern sollen. Unity ergänzt EMCs All-Flash-Portfolio eigenen Angaben zufolge um preiswerte Speicher für File- und Blockstorage und richtet sich vor allem an kleine und mittlere IT-Organisationen. EMC vervollständigt damit sein All-Flash-Angebot aus XtremIO, VMAX All Flash und dem erst kürzlich vorgestellten Hochleistungspeicher DSSD D5.

Unity bietet Anwendern eine HTML5-basierte Benutzeroberfläche mit einer Aufgaben-orientierten Struktur, die sich dem Hersteller zufolge einfach in VMware- und Microsoft-Umgebungen integrieren lassen soll. Unity verfüge außerdem über Proactive-Assist-Features, hieß es. Diese ermöglichten IT-Verantwortlichen, die Speichersysteme zu prüfen, zu steuern und weitgehend automatisiert zu verwalten. Überdies könnten Anwender Informationen zu ihren Unity-Geräten auch über EMC MyService360 abrufen, einer neuen Online-Serviceplattform für Echtzeit-Einblicke in Zustand und Gesundheit von EMC-Ressourcen.

Unity erreicht EMC zufolge bis zu 300k IOPS (Input/Output Operations per Second) und biete damit drei mal mehr Leistung als frühere VNX-Arrays. Das sind weitere Features von Unity:

- Unterstützung für File, Block und VVols,

- Snapshots und Remote-Sync- beziehungsweise -async-Replikation,

- native, Controller-basierte Verschlüsselung,

- neues, skalierbares Dateisystem für transaktionale und herkömmliche Anwendungen,

- integrierbar mit VMware VASA 2.0, VAAI, VVols, VMware-Aware,

- vollständige REST-API für Automation und DevOps,

- integriertes Copy Data Management durch EMC iCDM,

- Zero-impact garbage collection,

- skaliert bis zu 3 Petabyte Kapazität.

In ein 2-U-Array passen bis zu 80 TB All-Flash-Storage. Unity ermögliche EMC zufolge außerdem eine enge Verzahnung mit EMC Data Domain und der EMC Data Protection Suite. Das soll sicherstellen, dass Workloads jederzeit gut geschützt sind. Die Preise für All-Flash-Konfigurationen beginnen bei unter 18.000 Dollar, die für Hybrid-Konfigurationen bei unter 10.000 Dollar.

+++ SAS ANALYTICS IOT FÜR STREAMING – UND SENSORDATEN +++

SAS hat mit „Analytics for IoT“ verschiedene Softwarekomponenten zu einer Gesamtlösung gebündelt, die die Analyse sich schnell bewegender und extrem großer Datenmengen aus dem Internet of Things (IoT) erleichtern soll. Organisationen könnten mit Hilfe von Event Stream Processing volatile Datenströme bereits direkt nach ihrer Entstehung interpretieren und als Basis für strategische Entscheidungen nutzen, versrpicht der Softwarehersteller. SAS kombiniert in Analytics for IoT Streaming-Techniken, Analysen und Branchenerfahrung, um aus IoT-Daten Mehrwert zu generieren. Im Einzelnen geht es um Folgendes:

- Nützliche Daten finden: Intelligentes Filtern soll Unternehmen helfen, sich auf die Daten zu konzentrieren, die weiterverwendet werden sollen, statt kostspielig alle Daten zu speichern.

- Muster in den Daten erkennen: Organisationen könnten SAS zufolge IoT– Daten in angeschlossenen Systemen durchsuchen und analysieren sowie mit anderen Kontextinformationen kombinieren, um relevante Muster zu erkennen.

- Analysieren, noch während die Daten fließen: SAS Analytics for IoT sorgt für eine Analyse direkt im Daten-Stream (Event Stream Processing). Anwender könnten sich bei ihren Echtzeitaktionen auf Signale stützen, sofort nachdem sie erzeugt wurden – von einfachen Alerts bis zu komplexen automatischen Antworten.

*Martin Bayer ist stellvertretender Chefredakteur der Computerwoche.de

Be the first to comment