Die von einem Forschungsteam unter Leitung des Saarbrücker Max-Planck-Instituts für Informatik entwickelte KI-Methode DragGAN hat das Zeug dazu, die digitale Bildbearbeitung für immer zu verändern. [...]

Kleidungsstücke an einem digitalen Avatar anprobieren und von allen Seiten begutachten? Die Blickrichtung des Haustieres auf dem Lieblingsfoto anpassen? Oder die Perspektive auf einem Landschaftsbild verändern?

Diese und ähnliche Fotobearbeitungen haben bisher selbst versierte Profis vor Herausforderungen gestellt. Eine neue Methode verspricht nun, sie auch für Laien zugänglich zu machen – dank KI-Unterstützung ganz einfach mit wenigen Mausklicks.

Sie wird von einem Forschungsteam unter Leitung des Saarbrücker Max-Planck-Instituts für Informatik entwickelt, insbesondere von dem dort angesiedelten Saarbrücken Research Center for Visual Computing, Interaction and Artificial Intelligence (VIA).

Die neue Methode hat das Zeug dazu, die digitale Bildbearbeitung für immer zu verändern.

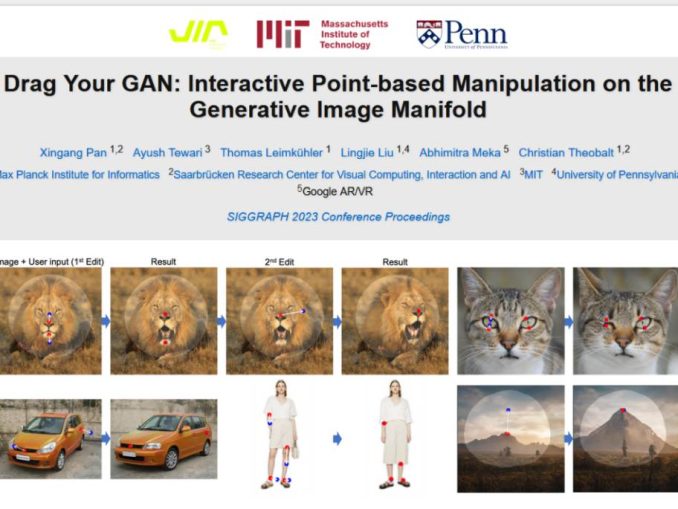

«Mit ‚DragGAN‘ entwickeln wir derzeit ein Werkzeug, das es dank einer übersichtlichen Nutzeroberfläche auch Laien ermöglicht, komplexe Bildbearbeitungen vorzunehmen. Sie müssen nur die Stellen im Foto markieren, die sie verändern möchten. Dann geben sie in einem Menü an, welcher Art die Veränderung sein soll – und mit nur wenigen Mausklicks kann jeder Laie dank KI-Unterstützung die Pose, den Gesichtsausdruck, die Blickrichtung oder den Blickwinkel auf einem Foto, beispielsweise von einem Haustier, anpassen», erklärt Christian Theobalt, geschäftsführender Direktor des Max-Planck-Instituts für Informatik.

Möglich macht das die Künstliche Intelligenz, genauer gesagt die «Generative Adversarial Networks», kurz GANs.

«Bei GANs handelt es sich um generative Modelle, also solche, die neue Inhalte wie Bilder synthetisieren können. ‚Adversarial‘ zeigt an, dass es sich um ein KI-Modell handelt, in dem zwei Netzwerke gegeneinander spielen», erklärt der Erstautor des Papers, Xingang Pan, Postdoktorand am Max-Planck-Institut für Informatik und am Saarbrücker VIA-Center.

In einem GAN arbeiten ein Generator, der Bilder erstellt, und ein Discriminator, der entscheiden muss, ob die Bilder echt sind oder vom Generator erstellt wurden, gegeneinander. Das System wird so lange trainiert, bis der Discriminator die Bilder des Generators nicht mehr von echten Bildern unterscheiden kann.

Die Einsatzmöglichkeiten von GANs sind vielfältig. Neben der offensichtlichen Anwendung des Bildgenerators sind GANs zum Beispiel gut darin, Bilder vorherzusagen: Die sogenannte Video-Frame-Prediction prognostiziert das nächste Bild eines Videos, was den Datenaufwand beim Videostreaming reduzieren kann. Die GANs können zudem niedrig aufgelöste Bilder hochskalieren und die Bildqualität verbessern, indem sie die Position der zusätzlichen Pixel der neuen Bilder vorhersagen.

«In unserem Fall erweist sich diese Eigenschaft von GANs als vorteilhaft, wenn in einem Bild zum Beispiel die Blickrichtung eines Hundes geändert werden soll. Das GAN berechnet dann im Grunde das ganze Bild neu und antizipiert, wo welches Pixel im Bild mit der neuen Blickrichtung landen muss. Ein Nebeneffekt davon ist, dass DragGAN auch Dinge berechnen kann, die vorher etwa durch die Kopfposition des Hundes verdeckt waren. Oder wenn der Nutzer die Zähne des Hundes darstellen will, kann er dem Hund auf dem Bild die Schnauze öffnen», erklärt Xingang Pan.

Auch im professionellen Kontext könnte DragGAN genutzt werden. Beispielsweise könnten Modedesigner den Zuschnitt von Kleidern nachträglich in Fotos anpassen oder Fahrzeughersteller könnten mit wenigen Mausklicks verschiedene Design-Konfigurationen eines geplanten Fahrzeuges durchspielen.

DragGAN funktioniere zwar bei verschiedenen Objektkategorien wie Tieren, Autos, Menschen und Landschaften, die meisten Ergebnisse seien bisher mit GAN-generierten, synthetischen Bildern erzielt worden. «Die Anwendung auf beliebige vom Benutzer eingegebene Bilder ist immer noch ein schwieriges Problem, das wir untersuchen», ergänzt Xingang Pan.

Das neue Tool der Saarbrücker Informatiker sorgte bereits wenige Tage nach Veröffentlichung des Preprints in der internationalen Tech-Community für Aufsehen und gilt vielen als der nächste grosse Schritt in der KI-gestützten Bildbearbeitung.

Während Tools wie Midjourney dazu genutzt werden können, neue Bilder zu erstellen, vereinfacht DragGAN die Nachbearbeitung von Bildern enorm.

Die neue Methode wird federführend am Max-Planck-Institut für Informatik und dem darin angesiedelten, gemeinsam mit Google eröffneten «Saarbrücken Research Center for Visual Computing, Interaction and Artificial Intelligence (VIA)» entwickelt, in Zusammenarbeit mit dem Massachusetts Institute of Technology (MIT) und der University of Pennsylvania.

Originalpublikation (Preprint):

Xingang Pan, Ayush Tewari, Thomas Leimkühler, Lingjie Liu, Abhimitra Meka, and Christian Theobalt. 2023. Drag Your GAN: Interactive Pointbased Manipulation on the Generative Image Manifold. In Special Interest Group on Computer Graphics and Interactive Techniques Conference Proceedings (SIGGRAPH ’23 Conference Proceedings), August 6–10, 2023, Los Angeles, CA, USA. ACM, New York, NY, USA, 11 pages.

https://arxiv.org/pdf/2305.10973.pdf

Projektwebsite mit Videodemo: https://vcai.mpi-inf.mpg.de/projects/DragGAN/

*Bernhard Lauer beschäftigt sich seit Jahrzehnten mit IT-Themen und bereitet diese als Autor und Redakteur auf – unter anderem für die dotnetpro. Programmieren gelernt hat er mit dem C64 und Basic. Er hat über die Anfänge von Java, JavaScript, HTML und .NET berichtet und sich zuletzt mit Python beschäftigt, nicht zuletzt deshalb, weil es ohne Semikolons auskommt ;-).

Be the first to comment