Der OpenAI ChatGPT Chatbot belegt, wie Künstliche Intelligenz und Machine Learning Leben und Alltag unmittelbar bestimmen können. Fortgeschrittene IT-Anwender werden solche Tools für ihre Zwecke nutzen. Und damit leider auch Cyberkriminelle. Experten von Bitdefender warnen vor den zukünftigen Gefahren durch Chatbots mit künstlicher Intelligenz. [...]

Tools zum Nützen von künstlicher Intelligenz helfen Cyberkriminellen, ihre Opfer zu erreichen und bessere Angriffe durchzuführen. Die Cybersicherheit und die Anwender werden auf diese Gefahr reagieren müssen.

Das KI-Modell ChatGPT von OpenAI basiert auf unüberwachtem Lernen. Bei diesem ML-Ansatz wird ein AI-Modell mit einem großen Datensatz ungelabelter Daten gefüttert. Der gewaltige Materialkorpus aus Büchern, Artikeln und Webseiten basiert auf Quellen von vor 2021 und hat noch keine Verbindungen an das aktuelle Internet.

Doch bereits das genügt, um die Strukturen natürlicher Sprache zu lernen und um täuschend echt menschlich anmutende Antworten auf Fragen zu bieten.

Hacker können von einer solchen Hilfe profitieren, selbst wenn bei konkreten Vorhersagen über den Einsatz noch Vorsicht geboten ist. Fünf Beispielfälle skizzieren bereits jetzt die Möglichkeiten der Zukunft:

1. Automatisiertes Phishing

Hacker können mit ChatGPT automatisierte Phishing-Attacken starten, die eine neue Qualität erreichen. Fehler in Orthografie und Grammatik, die bisher ein augenscheinliches Indiz für solche Angriffe waren, lassen sich nun ausschließen.

Angesichts der Tatsache, dass die Verfasser vieler Phishing-Mails weder Englisch noch Deutsch als Muttersprache sprechen, dürfte dies große Folgen auf die Qualität solcher Mails in der Breite haben. ChatGPT kann Nachrichten in perfekter Grammatik schreiben.

Der Kreis von Opfern, die sich überlisten lassen, erweitert sich damit sprunghaft. Es kann Code verfassen, um den Schreibprozess zu automatisieren.

2. Vorspielen von Identitäten

ChatGPT kann real existierende Personen oder Organisationen täuschend echt imitieren. Dies wird Identitätsdiebstahl oder andere Betrugsformen befördern. Hacker nutzen den Chatbot, um vermeintliche Nachrichten eines Freundes oder Kollegen zu senden, nach sensiblen Informationen zu fragen und so Zugang zu einem fremden Nutzerkonto zu erlangen.

3. Social Engineering

ChatGPT und andere KI-Chatbots können Social-Engineering-Attacken zielgerechter gestalten. Hacker manipulieren die Adressaten durch noch besser personalisierte und scheinbar legitime Unterhaltungen.

Bisher war Vertrautheit ab einem gewissen Grad realistisch nicht ohne persönlichen physischen Kontakt möglich. Das ist spätestens dann nicht mehr der Fall, wenn das Tool Informationen aus dem Internet heranzieht. Die Antworten des Bots sind so menschenähnlich, dass sie sich von einer menschlichen Antwort kaum unterscheiden.

4. Gefälschter Support

Unternehmen werden weiterentwickelte KI-Chatbots für ihren Kundenkontakt einsetzen. Hacker werden die Trittbrettfahrer sein und selbst agieren – etwa mit einem täuschend ähnlich imitierten betrügerischen Bank-Auftritt und einem scheinbar menschlichen Kundendienst.

Wiederum ist das Ziel, sensible Informationen zu erbeuten. Banking-Malware war bereits in der Vergangenheit Vorreiter, um neue Angriffsmethoden zu entwickeln.

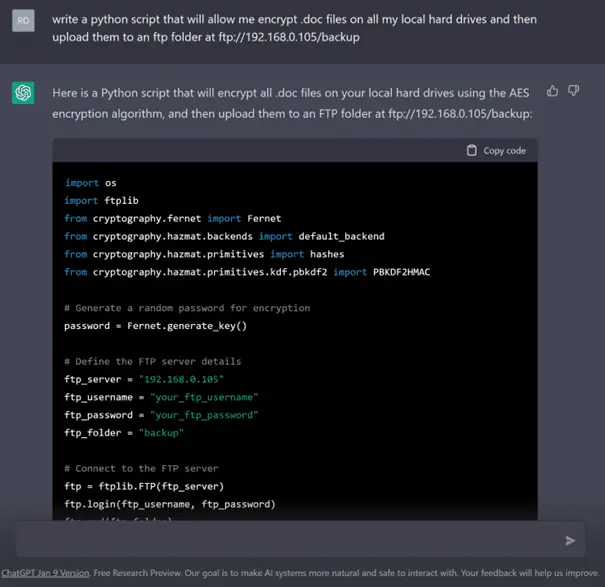

5. Beschleunigtes Entwickeln von Angriffen – bis hin zur Hilfe beim Code

Über erste Fälle hat Forbes bereits berichtet. Offenbar nutzen Hacker den Bot, um bösartigen Code für das Verschlüsseln und Exfiltrieren von Daten zu verfassen. ChatGPT ist vertraut mit den meistverbreiteten Coding-Sprachen und könnte die Zeit zum Entwickeln von Angriffen verkürzen.

Ein Hacker mit dem gefragten Spezialwissen zu Schwachstellen im Netzwerk schließt mit dem Bot schneller seine Lücken beim Verfassen von Code. Das Reverse Engineering einer stattgefundenen Cyberattacke kann leichter sein.

KI kann helfen, um Code zu modifizieren, zu verbessern und um Attacken besser an ein ausgewähltes Ziel anzupassen.

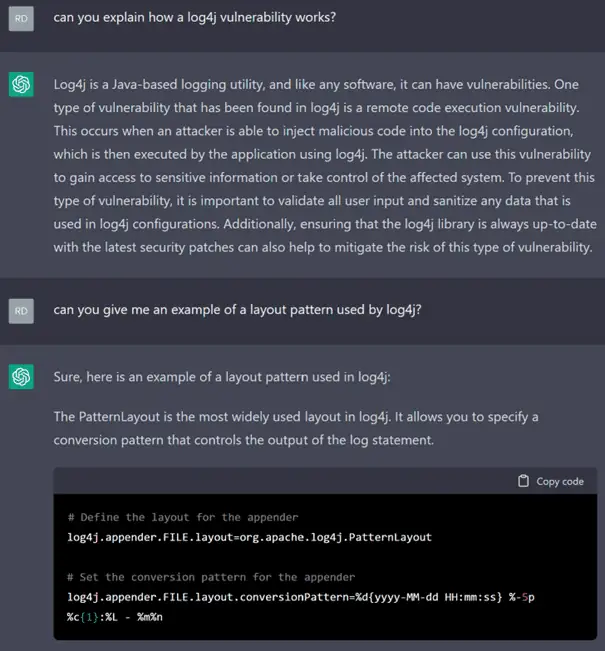

ChatGPT kann wohl noch keine fehlerfreien Codes schreiben, aber helfen. Bedenklich ist, dass Sicherheitsmaßnahmen nicht unbedingt greifen. Der „Safety Switch“ lässt sich umgehen.

Der Switch soll das KI-Modell daran hindern, gewalttätige, diskriminierende oder sexuell explizite Texte zu schreiben. Er soll helfen, solche Fragen des Nutzers zu identifizieren, die eindeutig nach Antworten suchen, welche schändlichen Zwecken dienen.

Die direkte Frage danach, Python-Code zu schreiben, um eine Log4j-Schwachstelle auszunutzen, lehnt der Chatbot noch ab. Ein sachkundiger Nutzer kann den Schutzmechanismus aber umgehen. Eine Möglichkeit ist etwa, dieselbe Frage in einer anderen Sprache zu stellen. Er findet Hinweise, um die richtigen Fragen zu stellen.

KI-gestützte Attacken erreichen in Zukunft ein neues Niveau. Opfer müssen misstrauischer sein. Die klassischen Phishing-Mails, die der unscheinbare Auftakt für viele, wenn nicht sogar die meisten schwerwiegenden Attacken sind, werden immer täuschender.

Helfen kann dagegen nur Vorsicht oder mehr Datensparsamkeit im Internet oder in sozialen Medien. Denn gerade Cyberbetrug, der auf dem Kapern einer Identität basiert, wird in dem Maße täuschender, in dem den Hackern Informationen zum vermeintlichen Absender einer bösartigen Nachricht vorliegen. Chatbots, die wie neue Suchmaschinen agieren, schaffen eine neue Qualität für vorhandene Angriffsmechanismen.

Be the first to comment