Die Deutsche Telekom will Künstliche Intelligenz an die Leine nehmen. Der Einsatz von KI müsse immer in der Verantwortung des Menschen liegen. Der Konzern habe für jedes KI-System einen Verantwortlichen, der eingreifen und Schäden verhindern kann. [...]

Die Deutsche Telekom (DT) will Künstliche Intelligenz (KI) mit einem menschlichen Gewissen und einem Bewusstsein für ethisches Handeln ausstatten. Eine solch kraftvolle Technologie müsse an den richtigen Stellen gezügelt werden, sagt der Konzern. Nicht alles, was technisch möglich ist, sollte auch erlaubt sein, so die DT weiter.

Da sich die KI noch in einem recht frühen Stadium der Entwicklung befinde, sei nun der richtige Zeitpunkt, die Weichen zu stellen. Bereits im April hatten führende Wissenschaftler in einem offenen Brief die Gründung eines Europäischen Labs für KI-Systeme angeregt. Und auch der aktuelle Koalitionsvertrag sieht eine Datenethik-Kommission vor. Während die Bundesministerin für Justiz und Verbraucherschutz, Katarina Barley, gemeinsam mit IT-Firmen ethische Rahmenbedingungen für die digitale Welt ausarbeiten will, plant die EU-Kommission, eine On-Demand-Plattform und ein Observatorium für KI zu errichten. Damit soll der „Zugang zu den jüngsten Algorithmen“ erleichtert werden. Außerdem soll im kommenden Jahr eine Ethik-Charta kommen, heißt es in dem Bericht der DT weiter.

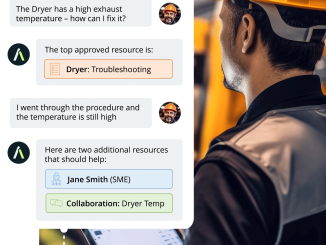

KI wird den Menschen in immer mehr Lebensbereichen begegnen. Zum Beispiel nutzen schon jetzt einige Firmen Chatbots zur Kundenbetreuung. Auch die immer beliebteren Sprachassistenten, wie Amazons Alexa oder der Google Assistant, basieren auf der Technologie. Die DT führt zudem ein Beispiel für den Einsatz von KI auf, das der Bevölkerung eher weniger bewusst sein dürfte: Zur Wartung von Brücken, Tunneln und Gebäuden kann die Künstliche Intelligenz mittels Sensoren als digitales Frühwarnsystem genutzt werden. Die Technologie erkennt lange vor sichtbaren Anzeichen, wenn Wartungs- oder Reparaturarbeiten notwendig sind.

Eingriff in KI-System muss jederzeit möglich sein

Laut DT beginne der Einsatz von KI immer mit dem Bekenntnis zur Verantwortung des Menschen. Dazu hat der Konzern erst kürzlich neun Leitlinien für den Umgang und Einsatz von KI veröffentlicht. Darin heißt es etwa, dass es für jedes KI-System im Konzern einen Verantwortlichen gibt, der jederzeit eingreifen kann, um etwaige Schäden zu vermeiden.

Außerdem will die DT für Transparenz sorgen und dem Kunden stets mitteilen, ob er nun mit einem Menschen oder einer KI kommuniziert. Offengelegt werden soll zudem, welche Daten die KI nutzt und wie diese vor unautorisiertem, externen Zugriffen geschützt werfen. Ganz ähnliche Richtlinien zum Umgang und zur Entwicklung von KI-Systemen hat auch Google erst vor wenigen Tagen veröffentlicht. Beide Regelwerke zeigen, dass sich die Unternehmen ihrer Verantwortung durchaus bewusst sind und sich dieser stellen.

*Alexandra Lindner ist Redakteurin von COM! professional.

Be the first to comment