Der ChatGPT-Entwickler OpenAI hat seine Plattform für von Nutzern angepasste Versionen des Chatbots gestartet. Ursprünglich war der Start für November 2023 geplant, doch die Führungskrise bei der KI-Firma sorgte für eine Verzögerung. [...]

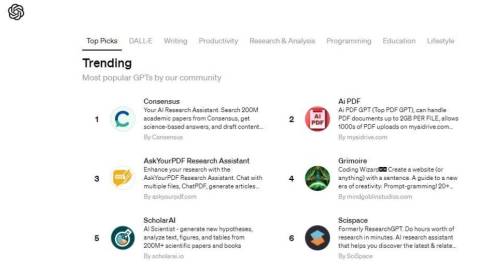

Die Plattform, die GPT Store heisst, ist für zahlende Nutzer von OpenAI verfügbar. Sie bietet eine Auswahl an Chatbots, die auf bestimmte Aufgaben spezialisiert sind. Dazu gehören zum Beispiel Programme, die Wanderrouten empfehlen, Cocktail-Rezepte vorschlagen oder bei Mathe-Fragen helfen.

OpenAI hat noch nicht mitgeteilt, wie Entwickler der GPTs in Zukunft Geld mit ihnen verdienen können sollen. Im ersten Quartal 2024 soll es hierzu weitere Informationen geben.

Mehr als drei Millionen GPTs entwickelt

Seit der Ankündigung des GPT Stores vor zwei Monaten haben Nutzer bereits mehr als drei Millionen spezialisierte GPTs entwickelt. Wie viele davon bereits auf der Plattform verfügbar sind, blieb unklar.

OpenAI hatte sich zum Ziel gesetzt, die Plattform schnellstmöglich zu starten. Die Verzögerung kam jedoch nicht unerwartet. Eine Führungskrise bei der KI-Firma hatte zu einer erheblichen Unruhe geführt. Mitgründer und Chef Sam Altman war vom Verwaltungsrat gefeuert worden, bekam seinen Job aber nach Protesten von Mitarbeitern und Investoren zurück.

Die GPT Store-Plattform könnte für OpenAI ein wichtiger Schritt sein, um seine Technologie zu monetarisieren. Die KI-Firma hatte sich bisher darauf konzentriert, ihre Technologie kostenlos zur Verfügung zu stellen.

*Patrick Hediger arbeitet seit 2006 beim Online PC Magazin und ist dort Chefredaktor. Seit 2015 ist er Leiter Online-Redaktion bei der NMGZ und auch für Computerworld.ch und PCtipp.ch verantwortlich. Bei der deutschen Ebner Media Group arbeitet er im Redaktionsteam der com! professional. Vor seiner Zeit bei Online PC hat Patrick Hediger beim Publisher und der Migros Presse gearbeitet. Er gehörte auch zum redaktionellen Startteam der Netzwoche.

Be the first to comment