Im Februar haben die Suchmaschinen Bing und Google ihre Suche mit neuen Funktionen aufgepeppt. Bing integriert ChatGPT, Google baut die Funktion der Google Lens deutlich aus. [...]

Lange Zeit führte die Suchmaschine Bing ein Schattendasein. Doch seit Microsoft angekündigt hat, ChatGPT in Bing zu integrieren, wirkte das wie eine Vitaminspritze. Nur wenige Tage nach der Bekanntgabe stieg die Zahl der Nutzer auf 31,7 Millionen Daily Visits. Die Daten des Webanalysten Similarweb belegen, dass am 8. Februar 2023 die Besucherzahlen auf der Website damit um 15 Prozent höher waren als an einem durchschnittlichen Tag in den letzten sechs Monaten.

Rob Wilk, Corporate Vice President von Microsoft Advertising wies in einem Blogbeitrag anschließend darauf hin, dass Nutzer künftig nicht nur lange Fragen eingeben und darauf von der Software ChatGPT ausformulierte Antworten erhalten können. Sondern dass dies auch neue Chancen für das Anzeigengeschäft bietet.

Denn wenn Microsoft selbst komplexe Suchanfragen in bislang ungewohnter Genauigkeit versteht und mit den Usern in einen längeren Dialog tritt, dann würde man auch ganz neue Einblicke in ihre Absichten erhalten. Und dann könnte man Werbungtreibenden intelligentere Möglichkeiten bieten, mit ihren Kunden in Kontakt zu treten.

Wilk: „Wir gehen davon aus, dass wir den Verbrauchern mit tiefgreifend personalisierten Erlebnissen noch relevantere Botschaften liefern können. Damit wird sich auch der ROI der Werbekunden verbessern. Das Potenzial dieser neuen Technologie wird noch erforscht, aber wir wissen, dass diese grundlegende Veränderung des Suchmaschinenerlebnisses die Experience von Anzeigen verbessern wird.“

Update für Google Lens

Während Bing von einer qualitativen Verbesserung und einer Steigerung seines SEA-Business ausgeht und die positiven Schlagzeilen genießt, peppt Google seine Suchmaschine mit weiteren Features auf.

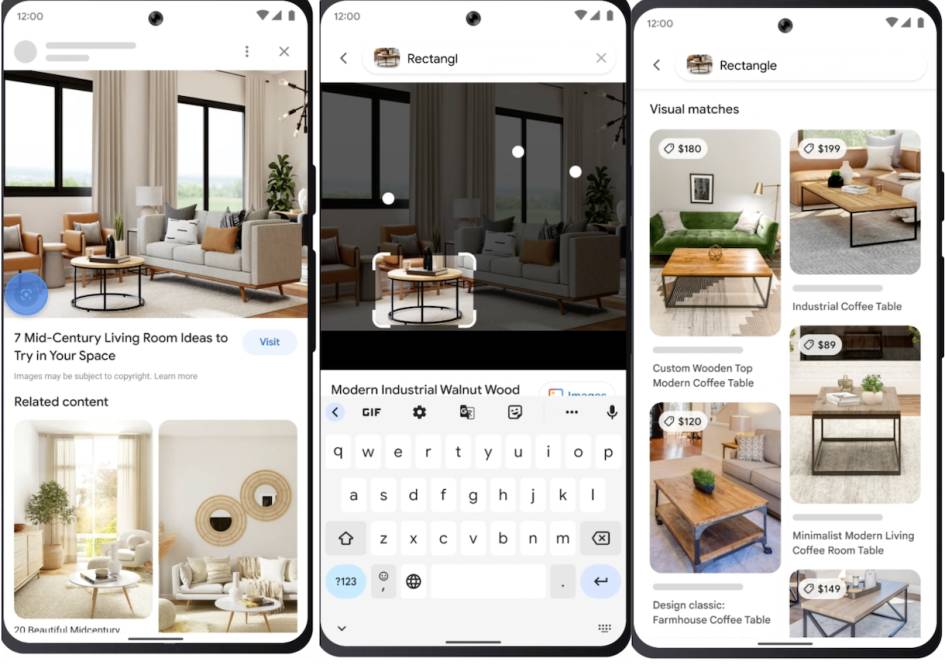

So wurde beispielsweise für Google Lens ein größeres Update vorgestellt. In den kommenden Monaten können Android-Nutzer mit der Lens ihren Bildschirm durchsuchen. Sie können auf Webseiten und Apps suchen, was sie dort auf den Fotos oder Videos sehen, ohne die App verlassen zu müssen.

Sieht man beispielsweise auf Social Media ein Video über Paris mit dem Eiffelturm, muss man künftig nur den Google Assistant aufrufen und dann auf die Bildschirmsuche tippen. Google Lens identifiziert den Eiffelturm und man kann mit einem weiteren Tipp mehr über das Wahrzeichen zu erfahren.

Auch für den E-Commerce dürfte dieses Update Konsequenzen haben. Ein weiteres Beispiel: Wird in dem Video ein Stuhl gezeigt, der dem User gefällt und über den er mehr erfahren möchte, muss er ebenfalls nur den Google Assistant aufrufen und auf die Bildschirmsuche tippen. Anschließend erhält er visuelle Suchergebnisse, die diesen Stuhl zeigen.

Auch die Kombi-Suche wurde weiter ausgebaut. Wer künftig über die Google-Lens-Funktion direkt mit der Smartphone-Kamera sucht, kann ab sofort im Bild auch einen Ausschnitt markieren. Steht also in einem Eck des Fotos ein kleiner, runder Tisch, kann gezielt nach diesem gesucht werden.

Mit einer weiteren Funktion kann diese Suche dann noch einmal variiert werden. Die User können beispielsweise eingeben, dass sie genau diesen Tisch suchen, aber in einer rechteckigen Variante.

(Quelle: Google)

Kombi-Suche mit lokalen Finessen

Erst kürzlich hatte Google diese „Kombi-Suche“ um lokale Komponenten ergänzt. Seitdem können User beispielsweise ein Foto von ihrem Lieblingsessen machen und sich in der Google App via „in meiner Nähe“ lokale Restaurants in der Nachbarschaft anzeigen lassen, die genau dieses Gericht auf der Karte haben.

Diese Funktion ist derzeit in den USA auf Englisch verfügbar und wird in den kommenden Monaten weltweit ausgerollt. „In den nächsten Monaten werdet ihr in der Lage sein, die Kombi-Suche global für jedes Bild zu nutzen, das ihr auf der Suchergebnisseite auf dem Handy seht“, so Elizabeth Reid, VP Search bei Google, in einem Blogbeitrag.

Google integriert Künstliche Intelligenz auch in Maps immer stärker. Es wird möglich sein, über das Smartphone diverse Orte von außen und innen zu erkunden. Das wurde von Google am Beispiel eines 3D-Modells des Rijksmuseums in Amsterdam vorgeführt.

Die Darstellung innerhalb von Maps berücksichtigt sogar das aktuelle Wetter. Spannend ist auch eine neue AR-Funktion, über die User Hinweise auf wichtige Orte wie Restaurants, Geldautomaten oder Bahnhöfe in der unmittelbaren Umgebung erhalten.

Was sonst im Bereich SEA/SEO im Februar noch wichtig war?

Google kennt keine optimale Keyword-Dichte

Zahlreiche SEO-Plugins empfehlen eine bestimmte Dichte an Keywords, damit der Beitrag auch gefunden wird und im sichtbaren Ranking auftaucht. Offenbar Unsinn, wie aus einem der Google-SEO-Sprechstunden hervorgeht.

„Nein, Google hat keine Vorstellung von einer optimaler Keyword-Dichte“, sagte der SEO-Experte John Mueller von Google. „Im Laufe der Jahre sind unsere Systeme recht gut darin geworden, zu erkennen, worum es auf einer Seite geht, selbst wenn die Keywords überhaupt nicht erwähnt werden.“

Die Dichte der Keywords spielt also keine Rolle. Trotzdem sei es wichtig, dass die wichtigsten Begriffe genannt werden. Im Gegensatz zu weit verbreiteten Vorurteilen aber nicht in allen möglichen Varianten.

*Als Fachjournalist analysiert Helmut van Rinsum seit vielen Jahren die Entwicklung der Medien sowie der Marketingkommunikation. Er schreibt seit regelmäßig für die INTERNET WORLD, zuvor war er unter anderem für das Magazin „Werben und Verkaufen“ tätig, zuletzt als stellvertretender Chefredakteur. Van Rinsum ist studierter Publizist, Autor der Fachbuchs „Der Social Media Rausch“ und Herausgeber des wöchentlichen Newsletters „Künstliche Intelligenz im Marketing“. Er ist Vater von drei Kindern und lebt mit seiner Familie in München.

Be the first to comment