Deep Fakes werden kaum noch als solche erkannt. Zu diesem Ergebnis kommt eine aktuelle Studie, die Probanden KI-generierte und echte Porträts präsentierte. [...]

Bilder von Gesichtern, die mithilfe von künstlicher Intelligenz generiert wurden, – sogenannte Deep Fakes – werden immer besser. Ja, sie sind mittlerweile derart täuschend echt, dass sie von vielen Menschen nicht als solche erkannt werden können.

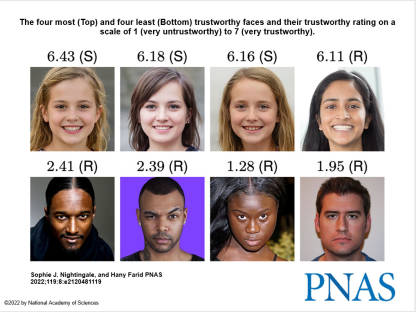

Im Gegenteil: Viele Betrachterinnen und Betrachter erachten die KI-Porträts als «echter» und «vertrauenswürdiger» als unverfälschte Fotos von Personen. Zu diesem Ergebnis kommt eine Studie, die im Fachblatt «Proceedings of the National Academy of Sciences USA» (Pnas) veröffentlicht wurde.

Geringe Trefferquote

Konkret sollten in einem Experiment mehrere Personen beurteilen, ob Bilder von verschiedenen Gesichtern echt oder gefälscht waren. Beim ersten Test lag die Trefferquote lediglich bei 48 Prozent, also nur so viele erkannten, ob ein Bild echt oder mithilfe von KI generiert war. Erst nach mehreren Versuchen pendelte sich die Trefferquote bei immerhin 59 Prozent ein.

Bilder von hellhäutigen Menschen waren dabei am schwierigsten als Deep Fakes zu entlarven, was die Forscher damit erklären, dass den Algorithmen mehr Bilder von hellhäutigen als von dunkelhäutigen Menschen vorgelegt wurden, die KI in diesen Fällen also mehr «Erfahrung» hat und daher besser arbeitet.

In einem weiteren Experiment, wurden die Teilnehmerinnen und Teilnehmer auch gebeten, zu bewerten, welche der vorgelegten Gesichterporträts am vertrauenswürdigsten aussahen. Auch hier gewannen die gefälschten Bilder gegenüber den echten. Dies sogar, obwohl auf den echten Bildern mehr und intensiver gelächelt wurde.

Be the first to comment