In diesem Kapitel wird ein Überblick über das KI-Gesetz (AI-Act) dargestellt. [...]

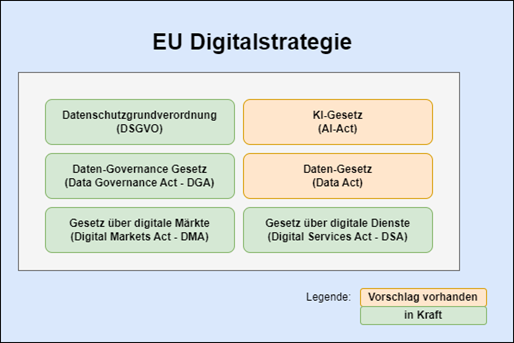

Die EU hat einige Verordnungen beschlossen – bzw. ist dabei sie zu beschließen, die unterschiedliche Themen abdecken. Teilweise stehen sie sogar im Widerspruch: während die DSGVO auf strengen Schutz von personenbezogenen Daten ausgerichtet ist, ist das Ziel anderer „Acts“ unter anderem, dass Unternehmen die Nutzungsdaten von Kund:innen teilen.

Man darf gespannt sein, wie sich die diese Regelwerke auf den technologischen Fortschritt auswirken werden. Die EU hat unterschiedliche Strategien zur Erreichung der Ziele der digitalen Dekade erstellt. Neben der EU-Digitalstrategie wurde auch eine EU-Datenstrategie entwickelt.

1. Komponenten der EU-Digitalstrategie

Die folgende Abbildung zeigt das Zusammenspiel der Komponenten der EU-Digital-strategie:

Details dazu finden sich in der Kolumne „Tagebuch eines Datenschutzbeauftragten“ der IT-Welt. In diesem Kapitel wird ein Überblick über das KI-Gesetzt (AI-Act) dargestellt.

2. AI-Act der Europäischen Union: Ein Überblick

Der AI-Act der Europäischen Union stellt einen bedeutenden Schritt in der Regulierung künstlicher Intelligenz (KI) dar. Dieses Regelwerk zielt darauf ab, den Einsatz von KI-Systemen in der EU zu standardisieren und sicherzustellen, dass diese Technologie im Einklang mit den Grundrechten und Sicherheitsstandards der EU eingesetzt wird.

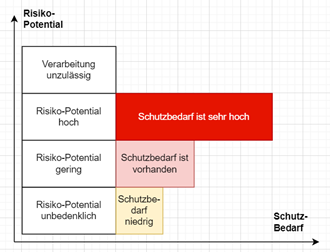

Kern des AI-Acts ist die Klassifizierung von KI-Systemen aufgrund ihres Risikopotentials. Die Einteilung erfolgt in vier Kategorien: unbedenklich, geringes Risiko, hohes Risiko und unzulässig.

Systeme mit hohem Risiko, wie solche, die in kritischen Infrastrukturen oder zur Überwachung eingesetzt werden, unterliegen strengen Anforderungen bezüglich Transparenz, Sicherheit und Datenschutz.

Unzulässige Praktiken, wie manipulative oder ausbeuterische Anwendungen, werden explizit verboten.

(Quelle: DSGVO-ZT GmbH)

In einer vorläufigen Version des AI-Act sind folgende Beispiele für Hochrisiko-KI-Systeme aufgelistet[1]:

- KI-Systeme, die zur biometrischen Identifikation verwendet werden.

- KI-Systeme, die als Sicherheitskomponenten (safety components) zum Managen und Betreiben von kritischen digitalen Infrastrukturen, im Straßenverkehr, in der Wasserversorgung, sowie bei Kraftwerken eingesetzt werden.

- KI-Systeme, die entscheiden, wer Zugang zu Bildung erhält oder die den Lernerfolg auswerten, um zu entscheiden welcher Bildungsweg eingeschlagen wird oder die Studierende monitoren und Fehlverhalten erkennen.

- KI-Systeme, die im Recruiting eingesetzt werden, die Entscheidungen treffen, die das Arbeitsverhältnis betreffen oder die Performance von Angestellten evaluieren.

- KI-Systeme, die von der öffentlichen Hand verwendet werden, um zu entscheiden, wer öffentliche Dienste und Unterstützung erhält. Dazu zählt auch die Gesundheitsversorgung.

- KI-Systeme, die die Kreditwürdigkeit von natürlichen Personen feststellen, mit Ausnahme von solchen KI-Systemen, die für die Erkennung von Betrug genutzt werden.

- KI-Systeme, die Notrufe von natürlichen Personen klassifizieren, und bewerten oder die dazu genutzt werden, um zu priorisieren wem zuerst geholfen wird. Das betrifft Polizei, Feuerwehr, Rettung und Notfall-Triage Systeme.

- KI-Systeme, die bei Lebens- und Gesundheitsversicherungen zum Bewerten von Risiken und zum Berechnen von Preisen genutzt werden.

- KI-Systeme, die von Sicherheitsbehörden eingesetzt werden, um das Risiko von natürlichen Personen zu berechnen Opfer eines Verbrechens zu werden.

- KI-Systeme, die in Polygraphen (Lügendetektoren) eingesetzt werden.

- KI-Systeme, die von Sicherheitsbehörden verwendet werden, um die Glaubwürdigkeit von Beweisen zu überprüfen oder die bei der Entdeckung, Untersuchung und Verfolgung von Straftaten eingesetzt werden.

- KI-Systeme, die im Asylwesen eingesetzt werden, um zu beurteilen welche Sicherheitsrisiken, Risiken für irreguläre Migration oder Gesundheitsrisiken von einer natürlichen Person ausgehen.

- KI-Systeme, die dazu genutzt werden, um Asyl-, Visa- und Aufenthaltsanträge zu beurteilen, sowie dazugehörige Entscheidungen zu unterstützen.

- KI-Systeme, die im Bereich Migration, Asyl, oder Management von Grenzen eingesetzt werden, um natürliche Personen zu erkennen und identifizieren.

- KI-Systeme die im Justizbereich eingesetzt werden.

- KI-Systeme, die verwendet werden, um Wähler zu beeinflussen.

Ein weiterer Aspekt des AI-Acts ist die Förderung von Transparenz und Nachvollziehbarkeit. KI-Systeme müssen so gestaltet sein, dass ihre Entscheidungen für Nutzer nachvollziehbar und überprüfbar sind. Dies erfordert klare Dokumentation und Offenlegung der Funktionsweise der Systeme. Anhang IV des AI-Act legt die wesentlichen Bestandteile der technischen Dokumentation fest:

- Generelle Beschreibung des KI-Systems

- Verfolgter Zweck (Name des Anbieters, Release Informationen des KI-Systems)

- Interaktionen mit anderen Systemkomponenten (sowohl Hardware als auch Software)

- Versions- und Updateinformationen

- Beschreibung, in welchen Formen das KI-System eingesetzt werden kann

- Hardwarebeschreibung, die für das KI-System verwendet wird

- wo das KI-System Teil eines Produkts ist inkl. Diagramme oder Illustrationen, die beschreiben, wie das KI-System in das Produkt eingebettet ist.

- Anleitung zur Verwendung für den Deployer und Beschreibung des User-Interfaces

- Detaillierte Beschreibung des KI-Systems und des Prozesses der Entwicklung insbesondere:

- Die Methoden und Schritte der Entwicklung des KI-Sytems, inkl. Verweise auf die verwendeten vortrainierten Systeme, Werkzeuge und wie diese durch den Anbieter verwendet wurden.

- Design Spezifikation des KI-Systems, seiner Algorithmen, Design-Entscheidungen, Benutzergruppen, Beschreibung des Outputs und der Beurteilung der Qualität des Outuputs.

- Beschreibung der Systemarchitektur, der Lösungsarchitektur, die Computing-Ressourcen, die verwendet wurden, um das System zu entwickeln, trainieren, testen, und validieren.

- Beschreibung der Daten inkl. der verwendeten Trainingsdaten, wie diese gesammelt, erstellt und verarbeitet wurden.

- Bewertung der menschlichen Überwachungsmaßnahmen

- Relevante Informationen, die beschreiben, dass das KI-System alle Vorgaben einhält

- Validierungs-, und Testprozeduren inkl. Beschreibung der verwendeten Daten. Beschreibung allfälliger Diskriminierung.

- Detaillierte Informationen über das Monitoring, die Funktionsfähigkeit und die Kontrolle des KI-Systems.

Zudem legt der AI-Act einen starken Fokus auf den Datenschutz. Die Verordnung verlangt, dass die Datenerhebung und -verarbeitung durch KI-Systeme im Einklang mit der Datenschutz-Grundverordnung (DSGVO) der EU steht. Dies beinhaltet unter anderem die Minimierung der Datenerhebung und die Sicherstellung der Datenqualität.

Für Entwickler und Unternehmen bringt der AI-Act neue Verpflichtungen und Herausforderungen. Sie müssen sicherstellen, dass ihre KI-Systeme den regulatorischen Anforderungen entsprechen, was möglicherweise umfangreiche Anpassungen in der Entwicklung und dem Betrieb erfordert.

Abschließend ist der AI-Act ein wichtiger Schritt zur Schaffung eines rechtlichen Rahmens für KI in der EU, der sowohl die Innovation fördert als auch die Rechte der Bürger schützt. Er steht exemplarisch für das Bestreben, Technologie verantwortungsbewusst und im Einklang mit ethischen Grundsätzen zu nutzen.

3. KI-Schlüsselanforderungen

Die EU schreibt in den „Ethikrichtlinien für vertrauenswürdige KI | Die digitale Zukunft Europas gestalten“ folgendes:

„Die Leitlinien enthalten eine Reihe von 7 Schlüsselanforderungen, die KI-Systeme erfüllen müssen, um als vertrauenswürdig zu gelten. Eine spezifische Bewertungsliste soll dabei helfen, die Anwendung jeder der wichtigsten Anforderungen zu überprüfen:

- Menschliches Handeln und Aufsicht:

- KI-Systeme sollten Menschen in die Lage versetzen, fundierte Entscheidungen zu treffen und ihre Grundrechte zu fördern. Gleichzeitig müssen angemessene Aufsichtsmechanismen sichergestellt werden, die durch Human-in-the-Loop-, Human-on-the-Loop- und Human-in-Command-Ansätze erreicht werden können.

- Technische Robustheit und Sicherheit:

- KI-Systeme müssen belastbar und sicher sein. Sie müssen sicher sein, einen Rückfallplan für den Fall gewährleisten, dass etwas schief geht, sowie genau, zuverlässig und reproduzierbar sein. Nur so kann sichergestellt werden, dass auch unbeabsichtigte Schäden minimiert und verhindert werden können.

- Datenschutz und Data Governance:

- Neben der Gewährleistung der uneingeschränkten Achtung der Privatsphäre und des Datenschutzes müssen auch angemessene Data-Governance-Mechanismen sichergestellt werden, die der Qualität und Integrität der Daten Rechnung tragen und einen legitimen Zugang zu Daten gewährleisten.

- Transparenz:

- Die Daten-, System- und KI-Geschäftsmodelle sollten transparent sein. Rückverfolgbarkeitsmechanismen können dabei helfen, dies zu erreichen. Darüber hinaus sollten KI-Systeme und ihre Entscheidungen in einer an den betroffenen Akteur angepassten Weise erläutert werden. Menschen müssen sich darüber im Klaren sein, dass sie mit einem KI-System interagieren, und sie müssen über die Fähigkeiten und Grenzen des Systems informiert werden.

- Vielfalt, Nichtdiskriminierung und Fairness:

- Unfaire Voreingenommenheit muss vermieden werden, da sie vielfältige negative Auswirkungen haben könnte, von der Marginalisierung schutzbedürftiger Gruppen bis hin zur Verschärfung von Vorurteilen und Diskriminierung. Um die Vielfalt zu fördern, sollten KI-Systeme für alle zugänglich sein, unabhängig von einer Behinderung, und relevante Interessenträger während ihres gesamten Lebenszyklus einbeziehen.

- Gesellschaftliches und ökologisches Wohlergehen:

- KI-Systeme sollten allen Menschen zugutekommen, auch künftigen Generationen. Es muss daher sichergestellt werden, dass sie nachhaltig und umweltfreundlich sind. Darüber hinaus sollten sie die Umwelt, einschließlich anderer Lebewesen, berücksichtigen und ihre sozialen und gesellschaftlichen Auswirkungen sorgfältig prüfen.

- Rechenschaftspflicht:

- Es sollten Mechanismen eingerichtet werden, um die Verantwortung und Rechenschaftspflicht für KI-Systeme und ihre Ergebnisse zu gewährleisten. Die Auditierbarkeit, die die Bewertung von Algorithmen, Daten und Designprozessen ermöglicht, spielt dabei eine Schlüsselrolle, insbesondere in kritischen Anwendungen. Darüber hinaus sollte ein angemessener zugänglicher Rechtsbehelf sichergestellt werden.

Weitere Details finden sich in Ethikrichtlinien für vertrauenswürdige KI.

4. Zusammenfassung

Der EU AI Act zielt darauf ab, eine umfassende Regulierung für den Einsatz von Künstlicher Intelligenz zu etablieren, um Risiken zu minimieren und ethische Standards zu gewährleisten. Es ist ein bahnbrechendes Regelwerk, das die Balance zwischen technologischer Innovation und gesellschaftlichem Schutz in den Vordergrund stellt.

5. Autoren

Das Tagebuch wird zur Verfügung gestellt von:

DSGVO-ZT GmbH

www.dsgvo-zt.at

Gast-Autor:

DI Herbert Mühlburger

IT-Ziviltechniker

AI-Trust ZT GmbH

office@it-zt.at

Be the first to comment